或許很多人還記得“微軟小冰”這個名字。它——或者更恰當地說,“她”——是微軟亞洲研究院在2014年推出的一個人工智能(AI)聊天機器人,現在已經出到了第五代,登陸了微博、微信、QQ等多個通訊或SNS平台。

“小冰”會主持節目,會寫詩,還會寫新聞,然而最讓人印象深刻的,還是小冰剛橫空出世的時候,眾多網友的爭相“調戲”或者“調教”。人們對於小冰這類AI運行機製的好奇,或許是調戲的主要動機;而AI必須要通過大量的數據輸入進行機器學習,調戲和調教也都是幫助她完善的一部分。

然而,假如我們把小冰的“人設”換一下,會出現什麼情況?

小冰在微軟官方設定中,是“年僅16歲的人工智能少女”(今年已經長到19歲),用戶下載或者在線連接小冰服務的行為,被稱為“領養”,小冰的頭像也是萌妹子的樣子。“在億萬人之中,我隻屬於你”,這個slogan即使拿到養成遊戲裏麵,也毫無違和感。不過,如果微軟把小冰設定成一個35歲的男性,試想“調戲”“調教”“領養”這些與用戶之間的關係,是否還存在呢?

你想“領養”一名35歲的男性嗎?圖片來源:msxiaoice.com

當然,本文並不是要批評這樣的人設——任何產品的設計都有其麵向的用戶和理由——而是打算探討一下:AI有沒有性別?如果有的話,AI的性別重要嗎?

智能助手開始向“中性”靠攏

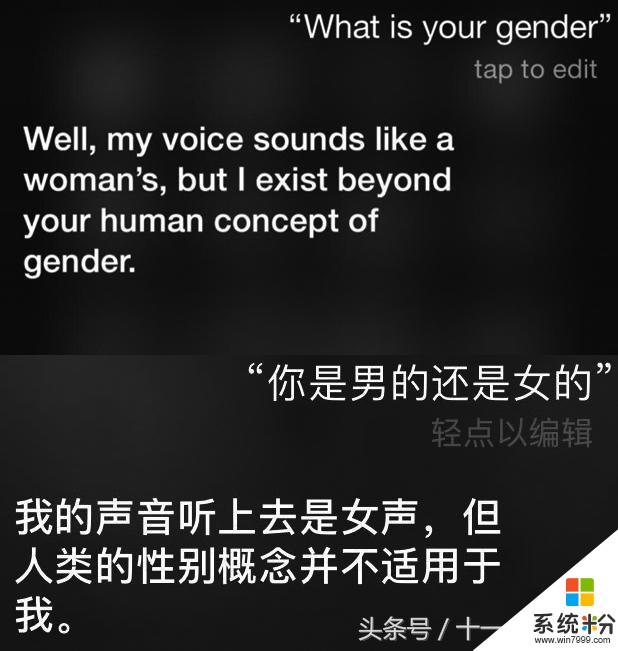

在市場營銷和公關活動下,AI小冰自然少不了人格化的噱頭。然而,目前市麵上最主流的智能助手(廣義上也算AI),蘋果的Siri、微軟的Cortana以及最近暢銷的亞馬遜Alexa,則都是無性別的存在(Cortana說自己的設定是女性,但沒有明顯的“女性”特征)。用戶可以選擇男性或者女性的聲音,而當用戶提問的時候,AI並不明示自己的性別。

問Siri性別時,它們的回答。

實際上,這個中性化的趨勢,也是最近幾年才有的。一開始的聊天機器人或者語音助手,總是以女性的形象出現。而這樣的人設,也使用戶(很多時候是男性)傾向於問一些“不太合適”的問題,甚至進行充滿性別意味的調戲。微軟的Cortana開發者曾坦承,早期Cortana接到的問題,“很大一部分是詢問Cortana的性生活”。

該如何對應用戶的“調戲”?Siri在一開始還會積極回應用戶的“調情”,偏向於更加“人性”(抑或說女性)的人設。比如,在英文操作環境下,問“我好看嗎?”一開始的Siri會回答“聽你的聲音,我覺得你應該還挺好看的”;而現在,Siri會比較冷淡地說“這個問題還是交給前置攝像頭吧”。至於更露骨的,類似於“我現在全裸”這樣的強烈性暗示語句,早期的Siri會模模糊糊地回應幾句(仿佛尷尬情景下的“岔開話題”);而現在則是表示這並不合適,也並不相關,語氣更加確定,或者像Cortana那樣,直接連接網絡,導到搜索結果頁麵。GoogleHome則在大部分時間表示“我聽不懂”。

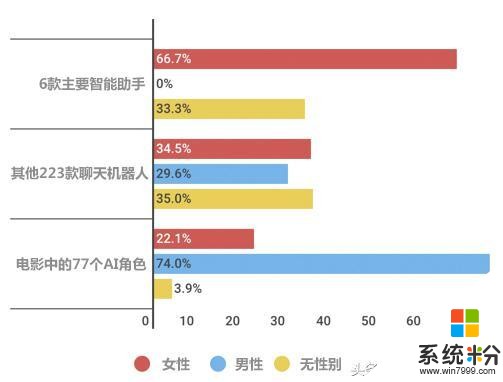

人工智能公司Integrate.ai的產品經理施內貝倫(Tyler Schnoebelen)分析了超過300個AI、聊天機器人和電影作品中虛擬的AI形象[1]。他發現,現在市麵上的聊天機器人性別分布非常均勻:35%女性、30%男性,剩下35%則沒有性別。人們已經逐漸跳出“陪聊女AI”的性別設定框架,接受不同性別,乃至沒有性別的AI為自己服務。但是,電影作品裏的AI則以男性為主。

聊天機器人的性別分布比較均勻,而電影作品中AI的設定則以男性為主。原圖來源:資料[1]

為什麼呢?人們對於性別的刻板印象會在AI身上顯現嗎?那麼AI到底有性別好,還是沒有好呢?

有什麼樣的人類,就有什麼樣的AI

人類對於人工智能“人化”的想象,是給它們所謂“人設”的原因。既然是人,就應該要有性別;而有了性別之後,開發者也會根據自己對於性別的認知,賦予這個角色性格和功能。這與人和人之間的交流有相似之處。換句話說,人會將機器人或者AI部分地看做“人”而不是電腦,從而在接觸的時候就對它(他或者她)產生某種期望。

研究表明,不管是設計開發人員還是一般人,都傾向於將性別刻板印象投射到機器人或AI身上,特別是與人類有交互的那一類AI。而性別判斷的來源,則是機器人/AI所發出的聲音,以及麵部的特征。一台電腦若是發出女性的語音,那麼人們對它的性能預估就不如一台男性語音主導的電腦[2];一個小孩臉的機器人會被人認為更親和,但它給出的意見,人們則不那麼願意采納——覺得它“不夠格”[3]。

德國比勒菲爾德大學的一項研究[4]表明,機器人顯現出的性別特征,會影響被試者對這個機器人能力和用途的判斷。實驗者給出了兩種機器人,並讓被試描述這些機器人可能的性格(比如是否友好、是否有判斷力,等等),以及會把這些機器人用於哪些場景(運輸、家務、教育,等等)。結果也並不意外:女性形象的機器人被視作更擅長溝通,人們更願意讓“她們”去做家務、護理等工作;而人們更願意男性形象的機器人來參與計算、機械類的工作。

而且,這樣的刻板印象不僅是第一眼印象,還會隨著人們和機器人/AI的互動而增強。在新加坡南洋理工大學的研究[5]中,研究者觀察了被試使用不同機器人完成不同工作的情況,並測量人們的反應。人們會偏好完成家政工作的女性機器人和完成安保工作的男性機器人,而不是相反。

於是也不難理解,要承擔與人溝通、聊天任務,並從事“文字工作”(也就是文本數據分析和應用)的小冰會被設定為女性。從被設定為女性身份的智能助手,再到套上“家政娘”人設的吸塵器,對於AI的性別印象,實際上也是人們社會中刻板印象的投射,也很想當然地被納入了設計者的考慮中。

中國科技大學研發的機器人佳佳的形象曾經引起了巨大爭議。圖片來源:新華社

對於AI和機器人性別的設定,也根植在了文化中。上麵已經提到,美國電影作品中的AI形象,有超過70%都是男性。實際上,女性的AI角色是近幾年才興起的(一半以上的女性AI都是2003年以後誕生的,而一半男性AI的角色早在1987年就有了)。在西方關於機器人和賽博的科幻想象中,從1927年的默片《大都會》裏挑起暴動的鐵皮機器人,再到《終結者》裏戰鬥力爆表的T-800,人們對於機器人或者AI的能力帶有一些敬畏甚至是懼怕,投射出的形象也帶有強烈的男性色彩(當然,有好的,也有邪惡的)。反觀日本,秉持“萬物有靈”的他們對於這種“擁有靈魂的機器”並無太多顧慮,反而熱衷於將機器人用於各類服務,“馴服”乃至“萌化”,其中也夾雜著物化女性的投射——或者被激進的批評家稱為“後人類的性別歧視”[6]。

2015年上映的電影《機械姬》中的女性AI形象頗具代表性。

還有一個重要的因素:機器學習的算法基於現有的數據和人們的行為,自然也會延續人們現有的偏好(最極端的例子就是微軟的Tay,上線不到一天就被“調教”成了極端種族主義和性別歧視者)。從開發者的角度看,現在人工智能行業的從業人員中,占主導地位的依然是男性。在美國,取得計算機科學相關學位的人中,女性僅占到20%。男性視角主導的AI“人設”,以及男性開發者對於AI功能和使用人群的想象,可能會延續到人工智能時代——女性人設的機器人成為了“由男性來設計一個完美女性的項目”[7];而國防軍事工程中的機器人,則統統被起上了爺們兒的大名[8]。這些可能是開發者自己都意識不到的偏見。

但AI是男是女,僅僅是功能和設計這麼簡單的問題嗎?抑或說,AI就一定要承擔人類的性格角色嗎?答案其實是不一定的,人們也有機會在AI身上改變傳統的刻板印象。

AI能否打破傳統性別角色?

又回到前麵所說:為什麼Siri和Alexa們都越來越中性了?實際上,不管是研究人員還是開發人員都在思考,AI時代的我們,能否在“人性”上有所突破和創新。一個沒有性別的“智能”,能否既讓人感覺到人性、實現自然的交流,又擁有突破兩種性別的優勢呢?

Kasisto是一個提供對話式人工智能服務的平台(主要給銀行提供客戶服務),它開發的KAI就以有人性但是無性別為標誌。它的人設就是“人工智能”,而沒有那些亂七八糟的性別年齡性格等等。它的形象既親和又專業,帶有一點小幽默,說話時候的語氣十分肯定——這正是一個理想的金融服務商所需要的。結果是,這樣的設定是最高效的,用戶的反饋也最積極。

這是一個好苗頭。實際上,人工智能並不一定要遵循“為人”的標準。早在1991年,著名的女性科技學者唐娜•哈拉維(Donna Haraway)就提出過一個“賽博宣言”[9],號召人們利用科技鑄就新的性別身份,在一個由機器、AI和機器學習主導的未來,乃至人機相融的未來,打破生理上性別的區隔和枷鎖。

另外一方麵,我們也希望這個社會的未來,是向多元、平等發展的,而不是通過更多的偏好算法來固著我們現有的偏見——社交網絡的好友圈和“點讚”機製製造了許多虛幻的“肥皂泡”,讓線上社會進一步撕裂,就是一例。一個由AI接管社會各方麵的未來,不應該是隻給女性推送化妝品廣告而給男性推送高管職位廣告的未來。AI應該在人們的幫助下,努力摒棄掉那些舊偏見,將更多人群、更多需求納入考慮。

我們必須承認,目前AI身上的刻板印象乃至各種智能算法對女性的“偏見”,都是我們現有社會的投射,它們的存在並不意外。然而,我們是否應該努力設想一個有更多可能性的未來呢?

相關資訊

最新熱門應用

智慧笑聯app官網最新版

生活實用41.45MB

下載

盯鏈app安卓最新版

生活實用50.17M

下載

學有優教app家長版

辦公學習38.83M

下載

九號出行app官網最新版

旅行交通28.8M

下載

貨拉拉司機版app最新版

生活實用145.22M

下載

全自動搶紅包神器2024最新版本安卓app

係統工具4.39M

下載

掃描王全能寶官網最新版

辦公學習238.17M

下載

海信愛家app最新版本

生活實用235.33M

下載

航旅縱橫手機版

旅行交通138.2M

下載

雙開助手多開分身安卓版

係統工具18.11M

下載