機器之心原創

作者:Smith

今年 7 月,世界頂級計算機視覺會議 CVPR(計算機視覺與模式識別會議)將在美國夏威夷舉行。在此之前,「微軟亞洲研究院創研論壇——CVPR 2017 論文分享會」近日已在北京中關村微軟大廈舉辦。與會嘉賓不僅包括來自北京大學、清華大學、上海交大等各高校的教授與在讀博士生,也有來自微軟亞洲研究院、中科院、英特爾中國研究院及商湯科技等的研究人員;會議期間,這些國內外計算機視覺領域學術界、工業界的優秀代表們攜各自在 CVPR 2017 發表的最新研究結果和相關技術觀點,在此次論壇上進行了分享與探討。

本次活動的組織者之一, 微軟亞洲研究院視覺計算組研究員王井東博士主持了開幕環節,微軟亞洲研究院的副院長潘天佑博士和中科院自動化研究所的王亮博士先後為此次會議致開幕詞。潘天佑博士表示此次活動有三個重要意義:

分享——來自不同高校、研究機構及企業的國內業界代表彙聚一堂,分享自己的成果;

推動——此次活動受到了各高校師生的強烈回響,20 餘位老師及 200 餘位與會學生積極參加,現場也提供了網絡直播,這些都推動了計算機視覺的普及與傳播;

思考——「學而不思則罔」,希望大家在總結過去成果的同時,也對計算機視覺未來的發展進行思考與展望

王亮博士表示,此次「CVPR 2017 論文分享會」將會提升國內視覺學者在國際上的影響力,並希望大家充分地交流溝通,擦出思想的火花。

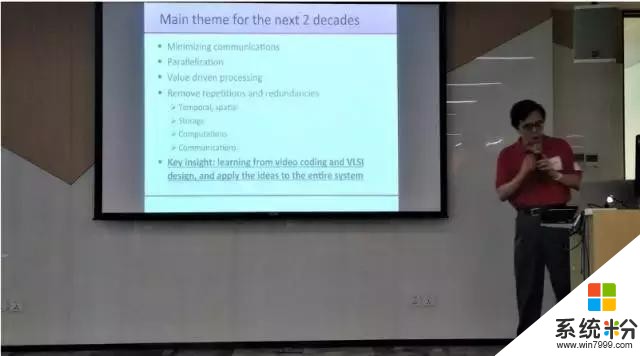

而清華大學的溫江濤教授則從硬件的角度闡述了我們現在所應用的計算機係統其實遠遠不夠完善,並且還有很大的開發潛力。他的觀點是:要從視頻編碼(video coding)和超大規模集成電路設計(VLSI Design)的角度進行進一步的研習,並且把相關理念應用到整個係統當中。他還把自己團隊所研發的視頻轉碼軟件的最新成果展示給了大家。溫教授表示這是第一個也是唯一一個應用基於實時 VR 係統的光流法的軟件,其轉碼率可比其他方法高出 60%。

整個論壇共包括 6 個不同主題的 session 和一個圓桌討論環節:

Session 1—Captioning and Computational Photography ;

Session 2—Learning (I)

Session 3—Detection and Parsing

Session 4—Learning (II)

Session 5—Face, Action, and Person Re-identification

Session 6—Hasing and Retrieval

Session 1:Captioning and Computational Photography

首先微軟亞洲研究院的廖菁帶來了題為 StyleBank:An Explicit Representation for Neural Image Style Transfer(StyleBank:神經圖像風格遷移的外顯表征)的相關內容。她的團隊在這一設計中運用卷積神經網絡作為基礎,在通過卷積作用得到特征層後,加入風格化分支——StyleBank 層作相應處理,可以得到很好的圖像效果。

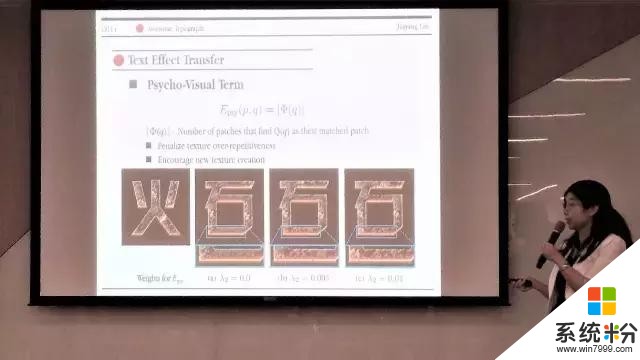

而北京大學的劉家瑛教授演講的題目為——Awesome Typography and Awful Rain Removal(文字風格化與去雨研究)。主要介紹了基於統計數據的文字效果遷移——即以斑塊圖形(patch pattern)和文本骨架距離(distances to the text skeleton)的高度相關性為出發點,對局部多尺度紋理(local multi-scale texture)、全局紋理分布(global texture distribution)和視覺逼真度(visual naturalness)進行目標函數構造。這一方法可以在貼合文字形狀的基礎上進行文字特效風格化,也生成了大量的藝術字體庫。除此之外,劉家瑛教授還介紹了她的「去雨」研究(Deep Joint Rain Detection and Removal from a Single Image)——基於多任務學習的方法對圖像中的「雨線」和「雨霧」進行檢測和去除,從而使圖像的主題內容呈現的更加清晰。這項研究有著重要的實際意義,可應用於惡劣天氣情況下的道路監控以及自動駕駛等領域。

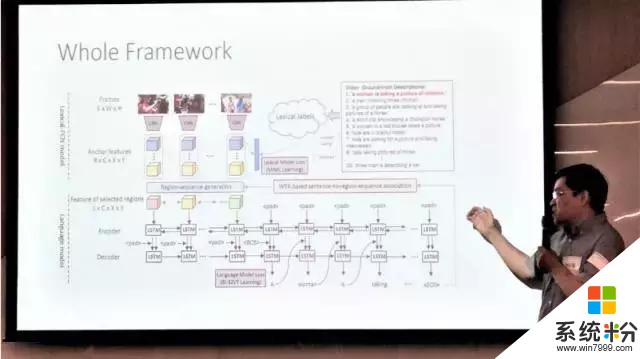

英特爾中國研究院的李建國展示了其 Weakly Supervised Dense Video Captioning(弱監督影像的字幕生成)的相關成果。(相關論文鏈接:https://arxiv.org/abs/1704.01502)

此項研究的目的是:在僅有影像級句子注釋(video level sentence annotations)的情況下,對每個輸入素材都生成多個不同且能提供有用信息的句子。此結構包括三個重要組成部分:1. 用詞庫進行區域等級(region-level)編碼的 Lexical FCN;2. 句子到區域序列的關聯(sentence to region-sequence association);3. 用序列到序列(sequence to sequence)的學習方法進行句子的生成。在這種方法中,Lexical FCN 用來進行弱區域建模(weakly region modeling);用 Lexical FCN 的輸出使句子和區域序列(region-sequence)相結合;僅用影像級的句子注釋來生成影像字幕;避免了 1:N(特征:句子)的匹配問題。

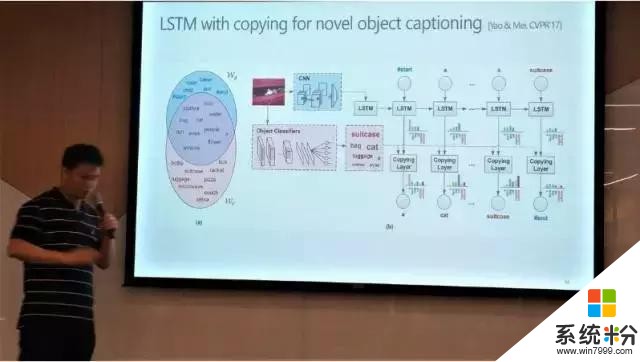

而微軟亞洲研究院的姚霆帶來的相關研究成果為 Image Captioning with Attributes,通過利用屬性(attributes)對圖像標注進行改進,這種方法有很大的潛力可以成為生成開放性詞彙句子(open-vocabulary sentences)的有效方法。這種以搜索為基礎的方法,應用卷積神經網絡加循環神經網絡,可以使圖像標注係統更加實用。

Session 2:Learning (I)

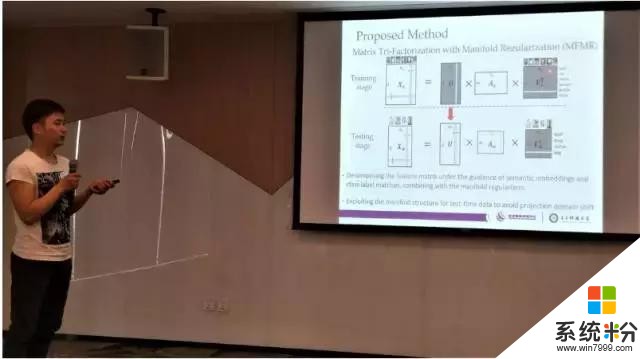

來自成都電子科技大學的宋井寬則帶來了理論性極強的內容——Matrix Tri-Factorization with Manifold Regularization for Zero-shot Learning。這種對矩陣進行因式分解的框架可以有效地在特征(features),屬性(attributes)和類別(classes)之間架起關係橋梁;利用測試數據的流形結構(manifold structure)可以增加精度,並且克服投影領域的移位(shift)問題;這種方法在「常規」和「一般化」的 Zero-shot Learning 設定中都很穩定。

Session 3 :Detection and Parsing

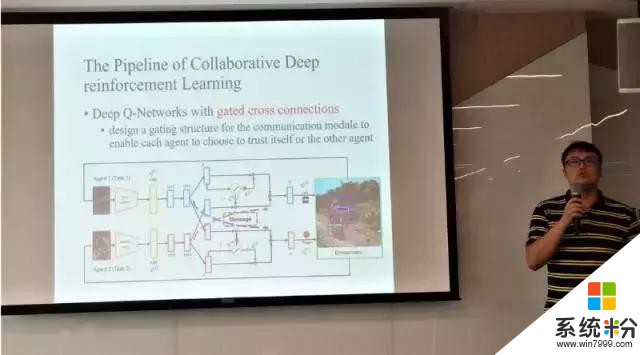

來自微軟亞洲研究院的辛博帶來了 Collaborative Deep Reinforcement Learning for Joint Object Search(用協作式深度強化學習進行連結式物體的搜索)。他提出了一種新的多智能體間的 Q-學習的方法,即門控選通式連接(gated cross connections)的深度 Q 網絡——給交流模塊設計一個門控結構,可以讓每個智能體去選擇相信自己還是相信別人。這是一種對虛擬智能體進行聯合訓練的高效方法。它有效地利用了相關物體間的有用的上下文情境信息(contextual information),並且改進了目前最先進的主動定位模型(active localization models)。

然後,華中科技大學的王興剛教授帶來了 Multiple Instance Detection Network with Online Instance Classifier Refinement(多實例檢測網絡與在線實例分類器改進)。而商湯科技的石建萍研究員則帶來了 Pyramid Scene Parsing Network(金字塔型情景解析網絡),這項研究成果也在去年的 ImageNet 比賽中摘得桂冠。

中科院信息工程所的劉偲研究員演講的題目是 Surveillance Video Parsing with Single Frame Supervision(基於單幀監督的監控錄像分析)。這種方法是第一個實現在每一段錄像僅標注一幀的情況下對監控錄像中的人進行分析的;而且由於提出的方法是端到端(end-to-end)的,因此非常適用於實際應用;此方法也有很好的延展性,可以對其它任務產生幫助,如行人再識別和人類特征預測等。(相關鏈接:http://liusi-group.com/projects/SVP)

Session 4: Learning (II)

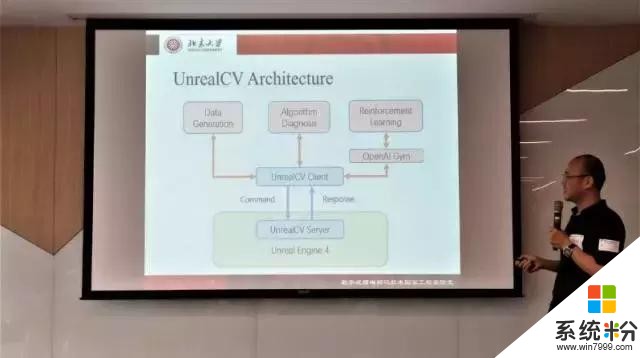

來自北京大學的王亦洲則帶來了題為 Agent in the Environment 的演講。他表示現在的機器視覺研究已經在圖像檢測識別算法以及靜態圖像理解方麵取得了不錯的成果,而接下來則需要將更多的精力投入到環境(Envrionment)、智能體(agents)、主動感知和學習、自適應、多任務學習(multi-task)以及自進化(self-evolution)當中去。

王亦洲教授所帶領的團隊研發出了一種先進的開發環境——UnrealCV Environment,這種開發環境有如下優點:

精準及實用的標注真值(ground-truther):生成可控數據(controllable data)用來進行訓練,並且用於評估智能體、算法(攝像頭、光源等);以任務驅動為基準。

這是一個連接智能體和環境的平台:提供試驗和錯誤的交互性環境(interactive Environment)以供智能體從經驗當中進行學習;智能體在保證成本最低(包括能源及損壞率)的情況下,可以很容易地從該平台中獲得常識性信息(common sense knowledge)。

環境的豐富度決定了智能水平的複雜度。

王教授又解釋了交互(interaction)是如何提高學習水平的:1. 可以避免一些靜態的觀點和圖像環境;2. 可以學習一些隱藏的屬性(比如慣性、硬度、新鮮度等);3. 獲得學習能力更強的學習者。

UnrealCV Environment 的一些優點:1. 現實性;2. 易於使用;3. 模型庫;4. 功能強大而且可以延伸;5. 相關文件齊全而且經過了檢驗。

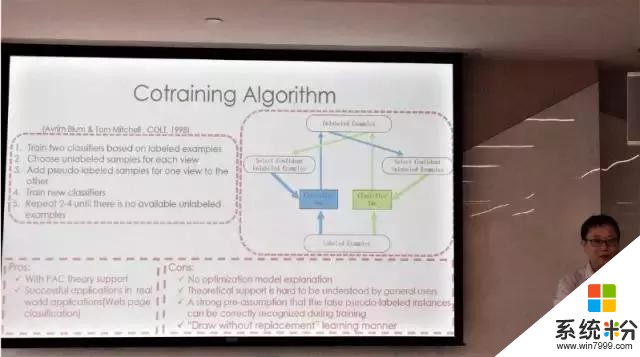

接下來,來自中山大學的袁淦釗教授介紹了 A Matrix Splitting Method for Composite Function Minimization(用於複合函數最小化的矩陣分解方法)的相關內容。而來自西安交大的孟德宇教授則介紹了一種新型的 Self-Paced Cotraining 模型和算法。這是一種「抽出後放回」(「draw with replacement」)的學習方法;它是用連續訓練(serial training)的方式來進行的。其合理性可以在沒有主觀假設的情況下被理解。

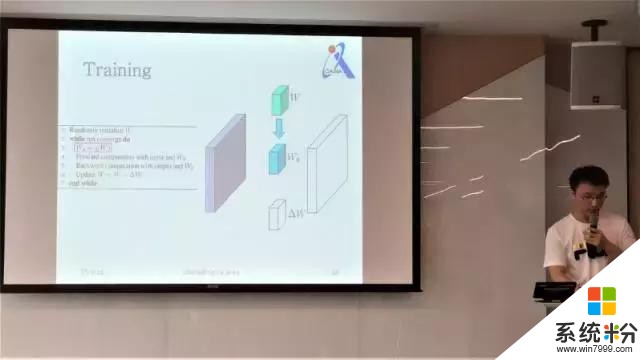

中科院自動化所的程健團隊則帶來了 Fixed-Point Factorized Neural Network(定點分解神經網絡)。一般的方法都是先做矩陣(張量)分解然後做定點運算(fixed point); 而這種方法是先進行不動點分解,然後進行偽全精度權重複原(pseudo full precision weight recovery),接下來做權重均衡(weight balancing),最後再進行微調(fine-tuning)。

Session 5:Face , Action , Person Re-identification

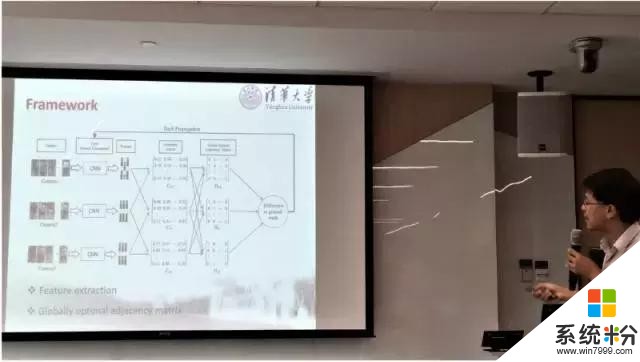

清華大學的魯繼文教授率先進行了題為 Consistent-Aware Deep Learning for Person Re-identification in a Camera Network(用一致性感知的深度學習方法在照相機網絡中進行人體再識別)的演講。這也是首次將端到端(end-to-end)的方法應用於照相機網絡行人再識別領域當中。

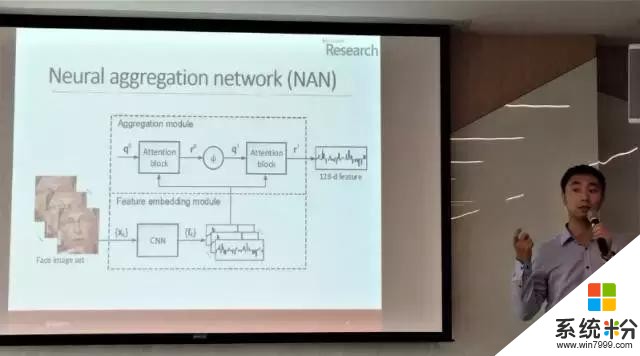

微軟亞洲研究院的楊蛟龍的相關研究是 Neural Aggregation Network For Video Face Recognition(用於視頻影像中人臉識別的神經聚合網絡)。傳統的深度學習方法在進行人臉識別時需要對每一幀都進行特征提取,這樣的效率是很低的。而 NAN 網絡可以對視頻或目標對象進行高度緊湊(highly-compact)的表征(128-d);利用注意力機製(attention mechanism)進行學習型聚合(learning-based aggregation);這種網絡在三個關於人臉視頻的基準中都有著一流的表現。楊蛟龍研究員表示這種聚合網絡是簡單並且通用的,今後也會用於其它一些視頻識別的任務當中。

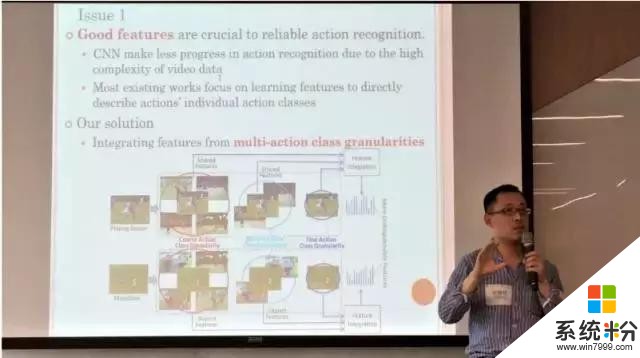

來自上海交大的林巍嶢教授演講的題目是 Action Recognition with Coarse-to-Fine Deep Feature Integration and Asynchronous Fusion(用 Coarse-to-Fine 深度特征集成和非同步結合的方法進行動作識別)。這是通過把粒度不同的多動作類別(multi-action class granularities)的特征進行集成來實現的。

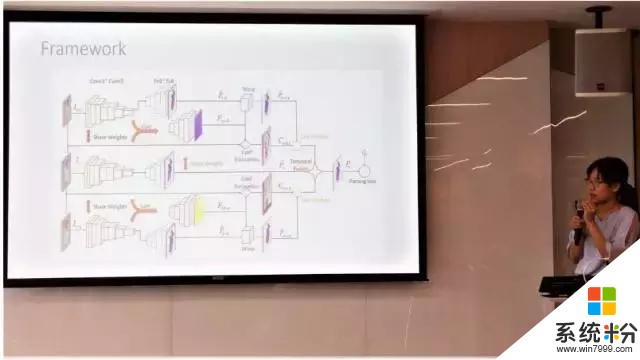

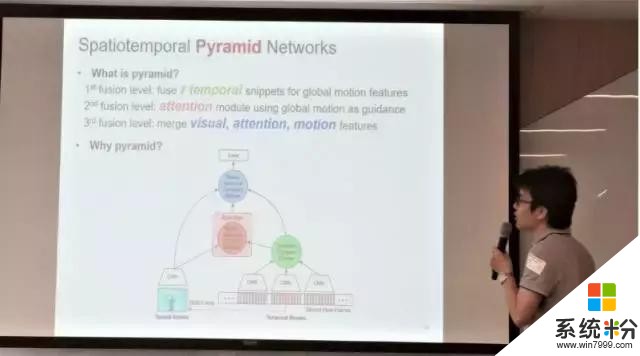

而清華大學的龍明盛的研究題目為 Spatiotemporal Pyramid Network for Video Action Recognition(用於影像動作識別的時空金字塔型網絡)。如下圖所示,該網絡稱之為金字塔型是因為其由下到上融合了三個處理階段。最下麵一層采用 CNN 在時間流 T 上獲取全局的運動特征。而向上第二層的注意力模型采用下層提供的全局運動特征作為向導。而最上麵的處理層則將視覺、注意力機製和運動特征結合起來計算損失函數。

Session 6:Hashing and Retrieval

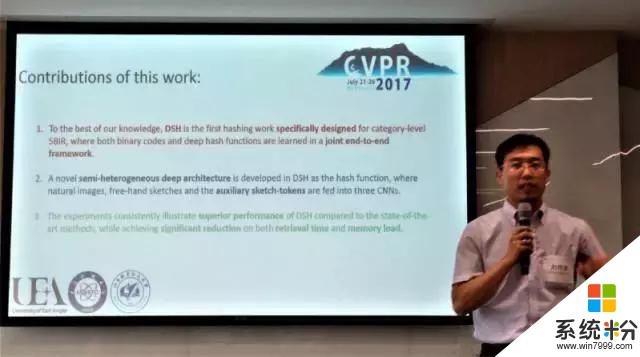

西安交大的薛建儒教授的學生高占寧和北京航空航天大學的劉祥龍教授分別帶來了 A Unified Framework for Event Retrieval, Recognition and Recounting 和 Deep Sketch Hashing:Fast Free-hand Sketch-Based Image Retrieval 的精彩內容。

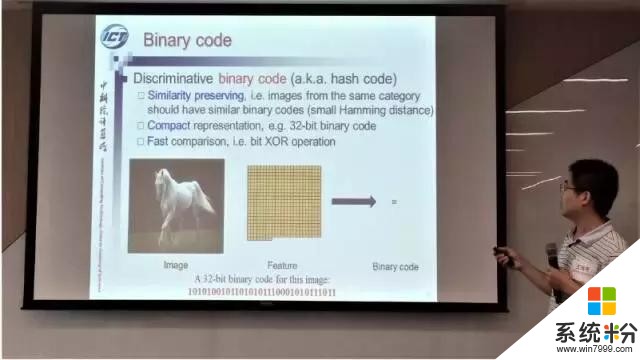

而廈門大學的紀榮嶸團隊和中科院計算所的王瑞平教授則分別帶來了 Cross-Modality Binary Code Learning via Fusion Similarity Hashing 和 Learning Multifunctional Binary Codes for Both Category and Attribute Oriented Retrieval。

其中王瑞平教授表示:同時對圖像表征(image representation)和哈希函數(hash function)進行學習能顯著提高性能(CFW-60K);而對特征屬性(attributes)和類別(classes)進行聯合學習(joint learning)也是可行的。(相關代碼和數據資料已經開源:http://vipl.ict.ac.cn/)。

在此次會議中期的圓桌討論環節,

陳熙霖,中國科學院計算技術研究所研究員

王蘊紅,北京航空航天大學計算機學院副院長

曾文軍,微軟亞洲研究院首席研究員

林宙辰,北京大學信息科學技術學院教授

齊國君,美國中佛羅裏達大學計算機係助理教授

五位計算機視覺領域的資深專家分別對:

「深度學習熱」對於計算機視覺領域的衝擊;

arXiv 對於領域發展的影響;

華人在 CVPR 2017 中的卓越表現;

以及在視覺領域應該怎樣設計一個真正可行的獎勵函數,來解決物體的檢測、分割、視頻捕捉等工作

等問題進行了十分精彩的解答與討論,詳情見《觀點 | 計算機視覺,路在何方》

附:CVPR 2017(國際計算機視覺與模式識別會議) 將於7月22號到7月25號在美國夏威夷舉行。今年的 CVPR 共收到有效提交論文共計2680篇。總計783篇被正式錄取(占總提交數的29%)。據統計,其中有華人參與的論文共占到總數的45%左右。詳細論文列表見官方網址:http://cvpr2017.thecvf.com/program/main_conference

感謝微軟亞洲研究院對本次報道的大力支持。

相關資訊

最新熱門應用

wbtc交易所app最新版

其它軟件179MB

下載

海星交易所蘋果app

其它軟件81.1MB

下載

多比交易所app

其它軟件28.28MB

下載

阿格斯交易平台安卓版

其它軟件12.3MB

下載

必安交易所官網app

其它軟件179MB

下載

afyex交易所

其它軟件15.87MB

下載

陽光出行車主端安卓最新版

旅行交通168.76M

下載

泰達幣app交易軟件安卓手機

其它軟件34.84M

下載

非小號交易平台官網

其它軟件292.97MB

下載

安卓probit交易所

其它軟件42.27MB

下載